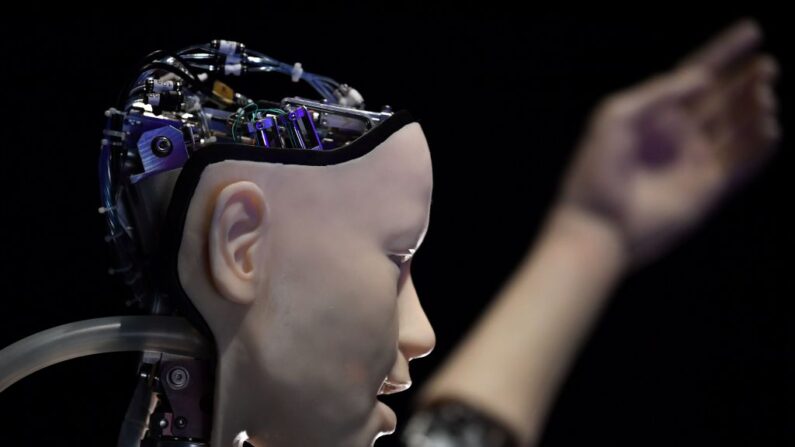

La Inteligencia artificial (IA) podría llegar a matar a “muchos humanos” dentro de dos años, a menos que se controle y regule adecuadamente, advirtió un asesor tecnológico del gobierno del Reino Unido.

Los riesgos a corto plazo que plantea la IA son “bastante aterradores”, dijo el asesor del primer ministro, Matt Clifford, en declaraciones a TalkTV el lunes. Según Clifford, la IA podría utilizarse para crear armas biológicas o lanzar ciberataques a gran escala, con el riesgo a largo plazo de crear una nueva especie que supere la inteligencia humana.

Clifford forma parte de la Foundation Model Taskforce (Grupo de Trabajo sobre Modelos Fundacionales) del gobierno británico, cuyo objetivo es el desarrollo de modelos fundacionales y de IA seguros y fiables, del tipo de ChatGPT y Google Bard.

Cuando se le preguntó por la amenaza de que la IA acabe con la humanidad, Clifford coincidió con la opinión de Elon Musk, afirmando que el riesgo “no es cero”.

“Si nosotros volvemos a cosas como las armas biológicas o los [ataques] cibernéticos, uno puede tener amenazas realmente muy peligrosas para los humanos, que podrían matar a muchos humanos —no a todos— simplemente de parte de donde nosotros esperaríamos que estuvieran los modelos dentro de dos años. Yo pienso que en lo que hay que centrarse ahora es en cómo asegurarnos de que sabemos controlar estos modelos, porque ahora mismo no lo sabemos”, afirmó Clifford.

Tras la entrevista, el asesor dijo en Twitter que, aunque los riesgos a corto y largo plazo de la IA son reales y “es correcto pensar mucho y con urgencia en mitigarlos”, existe “una amplia gama de opiniones y muchos matices al respecto”.

También advirtió contra una sobre regulación de la limitada IA, un tipo de IA que se centra en resolver un único problema específico.

Los sistemas de IA seguros y robustos podrían mejorar la vida cotidiana curando enfermedades, agregó a continuación.

“Yo quisiera que uno pueda ir a un hospital y tener un radiólogo humano, pero con un copiloto IA que sea realmente bueno detectando cánceres que el radiólogo podría pasar por alto. Creo que sería un verdadero desastre regular esto hasta la inconsciencia y hacer que esos beneficios no fueran posibles”.

En general, el riesgo y la oportunidad deben equilibrarse, agregó el asesor.

“La inteligencia artificial bien hecha sería el mejor avance tecnológico de nuestra especie”, indicó Clifford.

Barreras para la IA

Clifford, que preside la Agencia de Investigación e Invención Avanzada, argumentó que la IA debe regularse tanto a escala nacional como mundial.

Esto surgió después de que expertos de alto nivel en la IA, incluidos los de Google DeepMind y Anthropic, firmaran una carta a principios de este mes en la que afirmaban que “mitigar el peligro de extinción por la IA debería ser una prioridad global junto a otros riesgos a escala social como las pandemias y la guerra nuclear”.

En respuesta, el primer ministro británico, Rishi Sunak, dijo que su gobierno estaba “estudiando muy detenidamente” el tema.

“La semana pasada recalqué a las empresas de inteligencia artificial la importancia de poner barreras para que el desarrollo sea seguro”, declaró Sunak.

El 4 de mayo, la Autoridad de Competencia y Mercados puso en marcha una revisión del mercado de la IA para garantizar que las innovaciones en este campo sirvan a la economía, los consumidores y las empresas del Reino Unido sin vulnerar la transparencia y la seguridad adecuadas.

Durante su visita a Estados Unidos esta semana, Sunak tiene previsto plantear la cuestión de la regulación y la seguridad de la IA al presidente de Estados Unidos, Joe Biden. El portavoz del primer ministro dijo que no quería “adelantarse” a la conversación entre ambos líderes, pero sugirió que Gran Bretaña podría convertirse en líder mundial en nuevas tecnologías de IA y sistemas de regulación.

Por su parte, el Partido Laborista británico sostiene que se debe prohibir a los desarrolladores de tecnología que trabajen en la IA avanzada, a menos que cuenten con una licencia. El gobierno debería introducir regulaciones estrictas para las empresas que utilicen modelos fundacionales como ChatGPT, declaró a The Guardian Lucy Powell, portavoz digital del Partido Laborista.

En su intervención del martes, en la TechUK Tech Policy Leadership Conference, los ministros del gobierno británico, Chloe Smith y Paul Scully, hablaron de las oportunidades que ofrece la tecnología de IA cuando se aprovecha de forma “segura y responsable” y cuando el gobierno se asegura de que se hace “bien para toda la sociedad”.